微軟在人工智能領域再次邁出重要一步,正式推出了Phi-4家族的兩位新成員:Phi-4多模態(Phi-4-multimodal)與Phi-4迷你(Phi-4-mini)。這兩款模型在發布之初便引起了業界的廣泛關注。

Phi-4多模態模型是微軟在多模態語言模型領域的一次重大突破。它不僅集成了語音、視覺和文本處理能力,更以56億的參數量,在多項基準測試中展現了卓越的性能。與谷歌的Gemini 2.0 Flash及其輕量化版本相比,Phi-4多模態在多個維度上均表現出色。

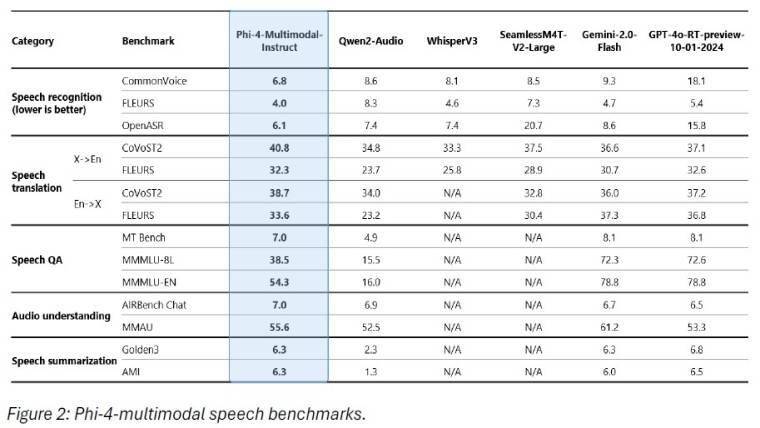

在語音處理方面,Phi-4多模態模型展現了其強大的實力。在自動語音識別(ASR)和語音翻譯(ST)任務中,它超越了WhisperV3和SeamlessM4T-v2-Large等專業模型,甚至在Hugging Face OpenASR排行榜上以6.14%的詞錯誤率奪得了榜首。這一成績無疑為Phi-4多模態模型在語音處理領域樹立了新的標桿。

而在視覺處理方面,Phi-4多模態同樣不甘示弱。它在數學和科學推理方面表現出色,尤其在文檔理解、圖表理解、光學字符識別(OCR)以及視覺科學推理等常見多模態能力方面,與Gemini-2-Flash-lite-preview和Claude-3.5-Sonnet等流行模型相比,不僅毫不遜色,甚至在某些方面實現了超越。

與此同時,Phi-4迷你模型則以其專注于文本任務的特點,吸引了大量開發者的關注。這款模型擁有38億的參數量,在文本推理、數學計算、編程、指令遵循以及函數調用等任務中均展現出了卓越的性能。與多款流行的大型語言模型相比,Phi-4迷你不僅在性能上毫不遜色,更在部署成本和效率上實現了顯著提升。

為了確保新模型的安全性和可靠性,微軟在推出Phi-4多模態和Phi-4迷你之前,進行了大量的內部和外部安全測試。同時,微軟還采用了人工智能紅隊(AIRT)制定的策略,對模型進行了進一步的優化。經過這些努力,Phi-4多模態和Phi-4迷你均成功通過了ONNX Runtime的部署測試,實現了跨平臺使用,適用于低成本和低延遲的場景。

目前,Phi-4多模態和Phi-4迷你模型已經正式在Azure AI Foundry、Hugging Face以及NVIDIA API目錄中上線,供開發者使用。這兩款新模型的推出,不僅標志著微軟在高效AI技術方面取得了重大進步,更為各類人工智能應用帶來了強大的多模態和文本處理能力。